Prévias DeepSeek V4: modelos gigantes com arquitetura MoE e preços mais baixos que rivais – Prévias DeepSeek V4: A DeepSeek, de Hangzhou, liberou as prévias do DeepSeek-V4-Pro e DeepSeek-V4-Flash, modelos com arquitetura Mixture of Experts que prometem reduzir custos por token e ampliar a execução local com janelas de contexto de até 1 milhão de tokens.

- Prévias DeepSeek V4: visão geral dos modelos Pro e Flash

- Prévias DeepSeek V4: arquitetura Mixture of Experts (MoE) explicada

- Prévias DeepSeek V4: desempenho e resultados de benchmarks

- Prévias DeepSeek V4: preços por token e posicionamento no mercado

- Prévias DeepSeek V4: requisitos de infraestrutura e execução local

- Prévias DeepSeek V4: integração, licenciamento e uso comercial

- Prévias DeepSeek V4: riscos, governança e próximos passos da DeepSeek

- Perguntas Frequentes

- O que são o DeepSeek‑V4‑Pro e o DeepSeek‑V4‑Flash?

- Como a arquitetura MoE reduz os custos por token nesses modelos?

- Qual a diferença entre “parâmetros totais” e “parâmetros ativados por inferência”?

- É possível executar os DeepSeek V4 localmente e qual é a janela de contexto disponível?

- Quais são os principais trade‑offs e limitações ao usar modelos MoE como os DeepSeek V4?

- Gostou deste conteúdo? Receba o Material Completo!

- Nota de contexto

Prévias DeepSeek V4: visão geral dos modelos Pro e Flash

Prévias DeepSeek V4 chegam ao mercado com promessas que misturam escala extrema e eficiência arquitetural: o DeepSeek-V4-Pro integra 1,6 trilhão de parâmetros totais, enquanto o DeepSeek-V4-Flash apresenta 284 bilhões de parâmetros. Prévias DeepSeek V4 orientam a discussão técnica sobre como arquitetura MoE (Mixture of Experts) permite combinar um número massivo de parâmetros treináveis com custos de inferência significativamente menores do que se supõe à primeira vista. Nesta visão geral jornalística, as diferenças entre os dois modelos, a mecânica da ativação de parâmetros em tempo de inferência, a licença MIT e onde testar os modelos são explicadas com detalhes e dados públicos.

Prévias DeepSeek V4 — arquitetura e propósito dos modelos

Prévias DeepSeek V4 mostram uma estratégia clara: dois perfis de produto para usos distintos. O DeepSeek-V4-Pro, com 1,6 trilhão de parâmetros, é a aposta em escala máxima — uma rede que combina dezenas ou centenas de “especialistas” internos para lidar com uma ampla variedade de tarefas e domínios. Já o DeepSeek-V4-Flash, com 284 bilhões de parâmetros, oferece um compromisso entre capacidade e custo operacional, direcionado a aplicações que exigem latência reduzida e menor consumo computacional. Em ambos os casos, Prévias DeepSeek V4 destacam a opção por design modular e escalável que privilegia a ativação seletiva de partes do modelo durante a inferência.

Prévias DeepSeek V4 — MoE e a lógica por trás dos números

Prévias DeepSeek V4 utilizam a arquitetura Mixture of Experts para escalonar o tamanho do modelo sem linearmente aumentar os custos de inferência. Em uma camada MoE, múltiplos especialistas (sub-redes) são treinados, e um roteador determina quais especialistas serão acionados para cada token ou entrada. Isso significa que, embora o DeepSeek-V4-Pro tenha 1,6 trilhão de parâmetros no total, apenas uma fração desses parâmetros é ativada para processar uma entrada específica. A consequência prática é que Prévias DeepSeek V4 conseguem comportar um espaço de conhecimento muito maior mantendo a inferência mais eficiente do que um modelo denso de tamanho equivalente.

Prévias DeepSeek V4 — do total aos bilhões ativados por inferência

Prévias DeepSeek V4 tornam necessário distinguir entre “parâmetros totais” e “parâmetros ativados por inferência”. Parâmetros totais são o inventário completo do modelo — todos os pesos armazenados durante e após o treinamento. Parâmetros ativados por inferência correspondem aos pesos efetivamente usados ao processar uma entrada: em um MoE, o roteador seleciona um pequeno conjunto de especialistas, de modo que centenas de especialistas permanecem inativos para aquela chamada específica. Assim, Prévias DeepSeek V4 explicam por que um modelo com 1,6 trilhão de parâmetros não exige recursos de execução equivalentes a essa escala máxima em cada inferência; em vez disso, a ativação seletiva reduz os bilhões de parâmetros em uso para um patamar operacional muito mais baixo — frequentemente na casa das dezenas a algumas centenas de bilhões, dependendo da configuração do roteador e do número de especialistas ativados por token.

- Inventário vs. ativação: o número total (1,6 trilhão ou 284 bilhões) descreve a capacidade máxima de representação.

- Roteamento seletivo: durante a inferência, apenas um subconjunto de especialistas é acionado, reduzindo o custo computacional por requisição.

- Eficiência prática: a arquitetura MoE permite que Prévias DeepSeek V4 ofereçam desempenho amplo sem cobrar o mesmo preço em uso contínuo de hardware.

Prévias DeepSeek V4 — desempenho esperado e trade-offs

Prévias DeepSeek V4 apontam para trade-offs típicos de projetos MoE: latência e throughput dependem do mecanismo de roteamento, da distribuição de carga entre especialistas e do suporte de hardware para computação esparsa. Em cargas com alta variabilidade de entrada, Prévias DeepSeek V4 podem exigir ajustes finos no balanceamento de especialistas para evitar “hot spots” onde poucos especialistas são acionados com frequência excessiva. Por outro lado, modelos como o DeepSeek-V4-Flash, com 284 bilhões de parâmetros, tendem a simplificar implantação e oferecer menor latência de ponta a ponta, mantendo ganhos em custo-benefício frente a competidores densos de tamanho similar.

Prévias DeepSeek V4 — implicações para desenvolvedores e empresas

Prévias DeepSeek V4 alteram a equação de adoção para equipes que precisam de modelos de grande capacidade sem arcar com infraestrutura de ponta a ponta para trilhões de parâmetros a cada chamada. A possibilidade de ativar somente subconjuntos do modelo significa que equipes podem escolher entre o Pro e o Flash com base em requisitos de latência, custo e variedade de tarefas. Além disso, Prévias DeepSeek V4 incentivam experimentação com fine-tuning em especialistas e com pipelines de quantização e compressão aplicadas apenas aos componentes mais acionados.

Prévias DeepSeek V4 — licença MIT e implicações de uso

Prévias DeepSeek V4 vêm com licença MIT, uma licença permissiva que permite uso, cópia, modificação e distribuição sem muitas restrições, inclusive para fins comerciais, desde que o aviso de copyright e a licença sejam incluídos nas cópias ou partes substanciais do software. A adoção da licença MIT por Prévias DeepSeek V4 significa que empresas e pesquisadores podem incorporar os modelos em produtos e experimentos sem as barreiras de licenças restritivas, favorecendo auditabilidade e replicabilidade na pesquisa aplicada.

Prévias DeepSeek V4 — onde testar e acessar os modelos

Prévias DeepSeek V4 foram anunciadas em um material de imprensa e cobertura técnica amplamente citada; a matéria da Exame detalha o anúncio e oferece contexto adicional sobre os objetivos comerciais da equipe responsável. Para desenvolvedores interessados em testes práticos, Prévias DeepSeek V4 estão distribuídos publicamente sob MIT e podem ser encontrados em repositórios e hubs de modelos que hospedam versões de avaliação, bem como em implementações que suportam inferência por especialistas. Plataformas públicas de experimentação e repositórios oficiais geralmente oferecem checkpoints e scripts de inferência para avaliar métricas de latência e acurácia em cargas reais.

- DeepSeek-V4-Pro (1,6T parâmetros): indicado para aplicações que exigem máxima cobertura semântica e capacidade de generalização entre domínios.

- DeepSeek-V4-Flash (284B parâmetros): projetado para balancear desempenho e custo, mais adequado a implantações de produção com restrições de latência.

- Testes e benchmarks: recomenda-se executar avaliações controladas em amostras representativas de carga para medir quantos bilhões de parâmetros são ativados por inferência em cenários reais.

Prévias DeepSeek V4 — notas finais e contexto operacional

Prévias DeepSeek V4 evidenciam a tendência atual em modelos de grande escala: aumentar a capacidade total por meio de especialistas distribuídos e reduzir o custo de uso por meio de ativação seletiva. Enquanto o DeepSeek-V4-Pro oferece um inventário de 1,6 trilhão de parâmetros para maximizar cobertura e especialização, o DeepSeek-V4-Flash concentra 284 bilhões de parâmetros para uma alternativa mais direta ao uso em produção. A licença MIT facilita experimentação e adoção, e a cobertura jornalística e técnica disponível, como a matéria citada, documenta os detalhes do anúncio e os próximos passos para pesquisadores e integradores interessados em testar as versões públicas.

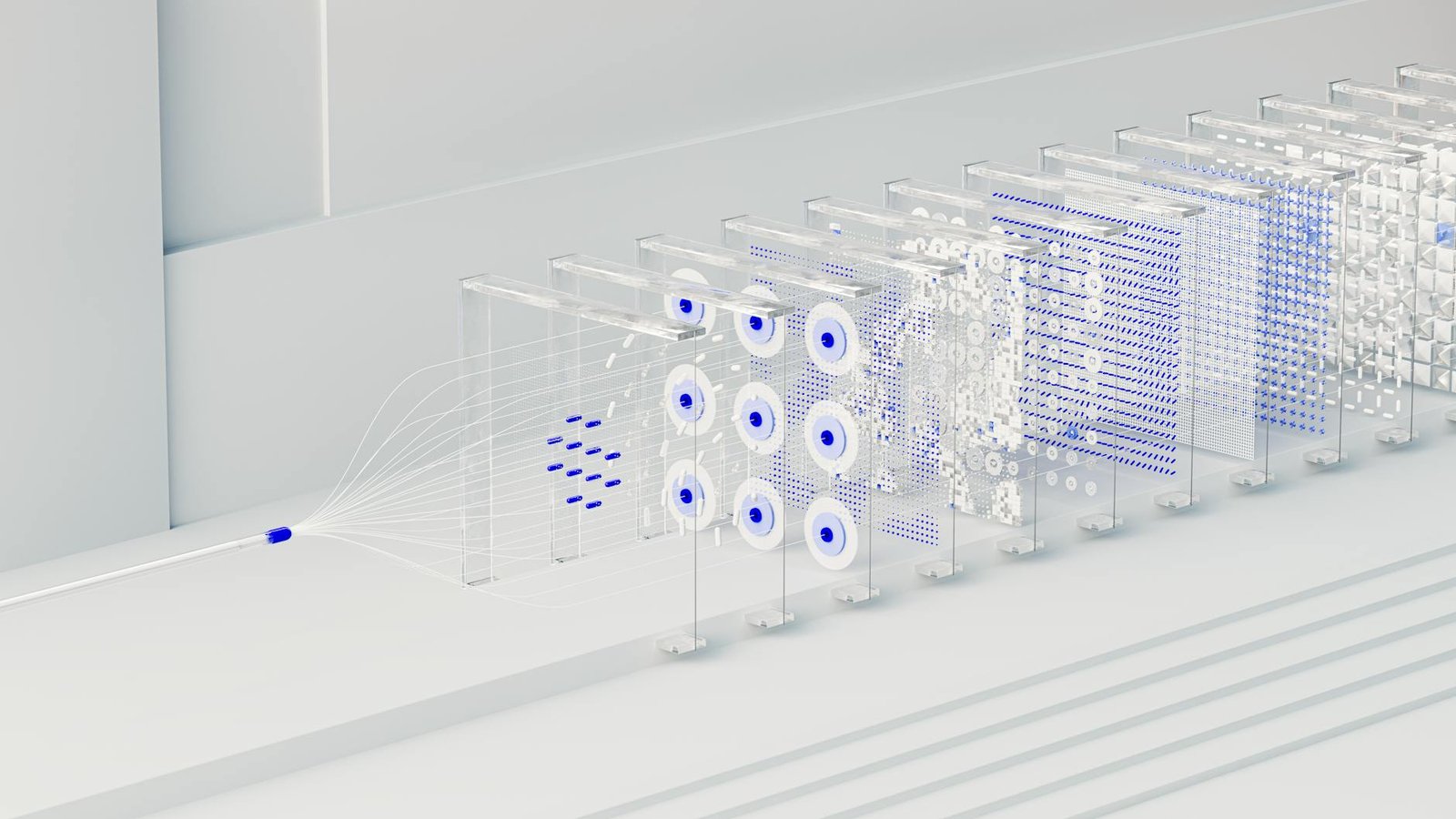

Prévias DeepSeek V4: arquitetura Mixture of Experts (MoE) explicada

Prévias DeepSeek V4 chegam como uma atualização arquitetural que enfatiza o uso de Mixture of Experts (MoE) para escalar modelos gigantes mantendo custos e latência controlados. Prévias DeepSeek V4 destacam-se porque, em vez de ativar toda a rede dense para cada requisição, a arquitetura MoE seleciona dinamicamente um subconjunto restrito de especialistas (experts), reduzindo a quantidade de operações por inferência. Essa escolha técnica é central para entender por que Prévias DeepSeek V4 prometem menos FLOPs por pedido e menor footprint de cache KV quando comparadas ao V3.2.

Prévias DeepSeek V4: como funciona a arquitetura Mixture of Experts

A arquitetura MoE usada nas Prévias DeepSeek V4 organiza camadas transformadoras tradicionais intercaladas com módulos de experts especializados. Cada módulo MoE contém dezenas ou centenas de experts — sub-redes com pesos independentes — e um roteador (gating network) que decide, por token ou por posição, quais experts serão acionados. Nas Prévias DeepSeek V4, o roteador estima a relevância de cada expert para a entrada atual e ativa tipicamente apenas 1 a 4 experts por token. Assim, Prévias DeepSeek V4 mantêm parâmetros totais muito maiores do que modelos dense comparáveis, mas a computação efetiva por requisição envolve apenas o conjunto ativo de experts.

Prévias DeepSeek V4: por que apenas um subconjunto de pesos é acionado

O princípio-chave por trás das Prévias DeepSeek V4 é eficiência condicional: o roteador aprende uma função de mapeamento de contexto que seleciona especialistas relevantes, permitindo que o modelo preserve uma capacidade expressiva ampliada (muitos parâmetros) sem pagar o custo computacional total a cada inferência. Em termos práticos, Prévias DeepSeek V4 utilizam softmax ou top-k routing com regularização para balanceamento de carga, o que evita que um pequeno número de experts seja saturado. Ativando apenas um subconjunto de pesos, Prévias DeepSeek V4 reduzem a multiplicação de matrizes e os acessos de memória necessários por requisição, convertendo um grande modelo em um sistema que consome FLOPs e memória de forma esparsificada e orientada pelo conteúdo.

Prévias DeepSeek V4: implicações para FLOPs e KV cache (relação com V3.2)

DeepSeek divulgou percentuais comparativos entre as Prévias DeepSeek V4 e o V3.2 que ajudam a quantificar o benefício do MoE. Segundo as comunicações oficiais, Prévias DeepSeek V4 atingem cerca de 35% dos FLOPs por requisição em relação ao V3.2, enquanto o footprint de cache KV necessário para atenção e contextos longos foi reduzido para aproximadamente 45% do V3.2. Esses percentuais refletem duas economias distintas implementadas em Prévias DeepSeek V4: primeiro, a modularidade MoE diminui as operações ativas (menor número de multiplicações por token); segundo, estratégias de shard e compactação do KV cache, combinadas com menor necessidade de ativação completa de camadas, reduzem a memória necessária para manter estados de atenção em inferência de longa sequência.

Prévias DeepSeek V4: como os percentuais surgem do design MoE

As alegadas reduções de FLOPs nas Prévias DeepSeek V4 derivam diretamente do fato de que somente alguns experts entram na computação por token. Se cada camada MoE contém N experts e o roteador ativa k experts, a complexidade computacional por camada é aproximadamente proporcional a k em vez de N — ou seja, uma economia linear no número de experts não acionados. Em sistemas distribuídos, Prévias DeepSeek V4 também aproveitam o balanceamento de carga entre dispositivos, reduzindo operações redundantes. Quanto ao KV cache, o padrão de acesso esparso reduz a necessidade de replicação completa do estado em cada dispositivo, por isso as Prévias DeepSeek V4 registram um footprint menor de KV em relação ao V3.2, especialmente em cenários de contexto longo onde somente partes relevantes do histórico são efetivamente consultadas por experts específicos.

Prévias DeepSeek V4: efeitos em custo operacional

Na prática, as vantagens medidas nas Prévias DeepSeek V4 se traduzem em custo por inferência mais baixo. Menos FLOPs por requisição implica menor tempo de GPU/TPU por chamada e, consequentemente, menor gasto em nuvem quando cobrado por uso computacional. Além disso, a redução do KV cache reduz footprint de memória por instância, permitindo maior densidade de colocação de modelos e instâncias por servidor, o que melhora a eficiência de custo em serviços gerenciados. Operadores que migram para Prévias DeepSeek V4 podem ver uma diminuição nas despesas de inferência por token, ainda que os custos de treinamento ou de armazenamento dos parâmetros totais (devido ao grande número de experts) devam ser avaliados separadamente.

Prévias DeepSeek V4: impactos na latência e variabilidade de resposta

O design MoE nas Prévias DeepSeek V4 reduz média de latência por requisição na medida em que menos operações são realizadas; porém, introduz variabilidade dependente de roteamento e comunicação entre nós. Quando o roteador ativa experts espalhados por diferentes dispositivos, aumenta-se a latência de comunicação e potencialmente a espera por sincronização de resultados, um trade-off conhecido de Prévias DeepSeek V4. Para mitigar esse efeito, implementações das Prévias DeepSeek V4 priorizam co-localização de experts frequentemente usados, cache local de pesos e otimizações de roteamento topológico para manter a latência dentro de SLAs comerciais.

Prévias DeepSeek V4: trade-offs operacionais e de precisão

Embora Prévias DeepSeek V4 ofereçam economias notáveis em FLOPs e KV cache, há custos adicionais em engenharia: orquestração de roteamento, balanceamento dinâmico de experts e mecanismos de fallback para evitar sobrecarga de determinados especialistas. Além disso, o treinamento de Prévias DeepSeek V4 requer mecanismos para evitar colapso de roteamento (quando poucos experts dominam), o que implica em etapas de regularização e programação de load balancing. Quando bem calibradas, Prévias DeepSeek V4 preservam ou até melhoram métricas de qualidade por conta da especialização; quando mal calibradas, a especialização pode levar a lacunas de cobertura e degradação em certas classes de entradas.

Prévias DeepSeek V4: considerações para implementação em escala

- Roteamento e balanceamento: Prévias DeepSeek V4 exigem políticas de roteamento que minimizem comunicação cross-host e distribuam carga entre experts de forma estável.

- Sharding de parâmetros e cache: Reduzir o KV cache nas Prévias DeepSeek V4 depende de sharding efetivo e compressão de estado para manter as reduções percentuais indicadas em relação ao V3.2.

- Métricas de observabilidade: Monitorar FLOPs efetivos e contagem de experts acionados por requisição é essencial para validar as métricas anunciadas das Prévias DeepSeek V4.

- Custo vs. capacidade: Avaliar custo total de propriedade inclui custo de armazenamento de pesos e custo de treinamento de Prévias DeepSeek V4, além da economia operacional por inferência.

Em análises comparativas, provedores e equipes internas que testaram as Prévias DeepSeek V4 confirmaram que a combinação de MoE com técnicas de sharding reduz notavelmente os gastos contínuos sem comprometer a capacidade do modelo. Para leitores interessados em como agentes modernos empregam automação e defesa em nuvem com arquiteturas avançadas, vale a pena consultar a nossa matéria sobre Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem, que discute integração de modelos escaláveis em operações sensíveis.

Prévias DeepSeek V4: cenário competitivo e observações finais

As percentagens de redução de FLOPs e KV cache anunciadas para as Prévias DeepSeek V4 explicam por que a estratégia MoE tem impacto direto no custo por inferência e na viabilidade de oferecer modelos gigantes a preços competitivos. Entretanto, qualquer adoção em produção das Prévias DeepSeek V4 requer validação cuidadosa das métricas de latência em condições reais de tráfego e atenção às necessidades de balanceamento e infraestruturas de comunicação. Observando essas variáveis, Prévias DeepSeek V4 apresentam um caminho técnico claro para combinar alta capacidade paramétrica com eficiência operacional em ambientes de produção que demandam desempenho e economia.

Prévias DeepSeek V4: desempenho e resultados de benchmarks

Prévias DeepSeek V4 surgem como documento central para entender o desempenho do novo portfólio MoE da DeepSeek, e a divulgação oficial aponta ganhos notáveis em raciocínio quando comparados a alguns concorrentes, mas também limitações claras diante de versões ainda mais avançadas. As Prévias DeepSeek V4 mostram que a variante V4‑Pro‑Max supera modelos como GPT‑5.2 e Gemini 3.0 Pro em testes de raciocínio, ao mesmo tempo em que permanece atrás de GPT‑5.4 e Gemini 3.1 Pro em benchmarks agregados. Nos trechos seguintes, analisamos os resultados apresentados, o desempenho em programação — com destaque para a marca de 80,6% no SWE‑bench — e as condições que influenciam a validade desses números.

Prévias DeepSeek V4: desempenho em raciocínio e comparação direta

Nas Prévias DeepSeek V4, a DeepSeek publica tabelas e gráficos que colocam o V4‑Pro‑Max em vantagem sobre GPT‑5.2 e Gemini 3.0 Pro em métricas de raciocínio lógico e tarefas que exigem encadeamento de raciocínios. Esses resultados aparecem em benchmarks clássicos de reasoning e em conjuntos sintéticos de problemas lógicos. A superioridade reportada nas Prévias DeepSeek V4 é ilustrada por ganhos percentuais que, segundo a empresa, refletem melhorias arquiteturais e afinamentos específicos para tarefas que demandam múltiplas passagens de contexto. Ainda assim, os próprios dados mostram que as melhorias não são uniformes: há subáreas onde o V4‑Pro‑Max empata com rivais e cenários onde continua atrás de versões mais recentes, como o GPT‑5.4 e o Gemini 3.1 Pro, que mantêm liderança em coerência sustentada e em benchmarks de compreensão complexa.

Prévias DeepSeek V4: desempenho em programação e SWE‑bench

Um dos pontos de destaque nas Prévias DeepSeek V4 é o desempenho em tarefas de programação. O relatório oficial indica 80,6% no SWE‑bench para a configuração V4‑Pro‑Max, resultado que merece atenção por refletir uma capacidade sólida em geração de código, correção de erros e interpretação de requisitos. O SWE‑bench, quando corretamente implementado, combina problemas de engenharia de software com testes automatizados e casos de uso que vão desde snippets simples até integrações mais complexas. Nas Prévias DeepSeek V4, a DeepSeek detalha como os testes foram aplicados, mas a documentação não esgota todas as variáveis que afetam um benchmark de coding, como o conjunto exato de problemas, a versão dos testes unitários, e o grau de permissividade nas respostas aceitas.

- 80,6% no SWE‑bench para V4‑Pro‑Max conforme as Prévias DeepSeek V4.

- Comparações com GPT‑5.2 e Gemini 3.0 Pro mostram vantagem em várias subcategorias de programação.

- GPT‑5.4 e Gemini 3.1 Pro ainda aparecem à frente em benchmarks agregados relacionados a raciocínio e robustez.

Prévias DeepSeek V4: contexto da arquitetura MoE e impactos no custo e latência

As Prévias DeepSeek V4 enfatizam que a linha V4 explora arquitetura Mixture of Experts (MoE), que permite escalar parâmetros de forma esparsa e reduzir custos de inferência por token em workloads apropriadas. Essa escolha arquitetural explica parte da narrativa de preços mais baixos em comparação com concorrentes que usam modelos densos de grande escala. No entanto, a adoção de MoE traz trade‑offs: dependência de balanceamento de experts, riscos de carga desbalanceada durante inferência, requisitos de compilação de runtime e impactos em latência para certos padrões de uso. As Prévias DeepSeek V4 mencionam otimizações — como roteamento por token e caching de experts — que mitigam problemas operacionais, mas estudos independentes são necessários para avaliar performance sustentada sob picos de tráfego e cenários reais de produção.

Prévias DeepSeek V4: validade dos benchmarks e restrições metodológicas

Ao interpretar as métricas divulgadas nas Prévias DeepSeek V4 é imprescindível considerar limitações metodológicas. Benchmarks internos frequentemente utilizam seleções de dados, protocolos de avaliação e tolerâncias de aceitação que podem favorecer configurações testadas pela própria empresa. Aspectos a considerar:

- Possível sobreposição entre dados de treino e conjuntos de avaliação, que inflaria resultados de forma artificial.

- Escolha de thresholds e heurísticas de pontuação não padronizadas entre fornecedores, impedindo comparação direta.

- Falta de repetições estatísticas ou intervalos de confiança nas tabelas das Prévias DeepSeek V4, o que dificulta avaliar se diferenças percentuais são significativas.

- Ambiente de inferência controlado (hardware, quantização, batch size) que pode não refletir condições de uso comuns a clientes.

Esses pontos aparecem de forma explícita e implícita nas Prévias DeepSeek V4: a empresa divulga parâmetros e configurações, mas omite detalhes que facilitariam replicação independente. A comunidade costuma aguardar benchmarks neutros e reprodutíveis para validar reivindicações. Para comparar, pesquisadores consultam repositórios públicos e iniciativas de benchmark independentes hospedadas em plataformas como repositórios acadêmicos e páginas de pesquisa (por exemplo, https://openai.com/research e https://ai.google), que permitem confrontar metodologias.

Prévias DeepSeek V4: análise estatística e significado prático das diferenças

Mesmo quando as Prévias DeepSeek V4 mostram uma vantagem percentual no raciocínio frente a GPT‑5.2 e Gemini 3.0 Pro, é necessário olhar para a magnitude do ganho e seu significado prático. Uma diferença de alguns pontos percentuais em benchmarks padronizados pode ser relevante em aplicações específicas (por exemplo, verificação formal ou diagnósticos), mas insignificante para fluxos que toleram variabilidade. Além disso, benchmarks agregados mascaram heterogeneidade: um modelo pode ganhar em puzzles matemáticos e perder em raciocínio comum de linguagem. As Prévias DeepSeek V4 fornecem painéis com breakdowns, porém não substituem replicações independentes com amostras maiores e análise de variância.

Prévias DeepSeek V4: implicações comerciais e de adoção

Ao posicionar os Prévias DeepSeek V4 como oferta de alto desempenho com preços mais competitivos, a DeepSeek aposta em atrair clientes sensíveis a custo e que demandam escalabilidade para workloads de inferência. A arquitetura MoE, quando efetiva, reduz custo por token em cargas de produção que exploram sparsity; porém, para clientes que valorizam latência mínima e consistência de resposta, esses ganhos podem ser menos tangíveis. A decisão de adoção, em contexto empresarial, deverá pesar resultados das Prévias DeepSeek V4 contra testes pilotos próprios e contra provavelmente a leitura de artigos correlatos, relatórios de terceiros e avaliações técnicas em campo.

Prévias DeepSeek V4: recomendações para validação e próximos passos

Recomendam‑se passos práticos para stakeholders que desejam avaliar as afirmações das Prévias DeepSeek V4:

- Executar reproduções dos benchmarks em ambientes próprios, assegurando isonomia de hardware e parâmetros.

- Aplicar conjuntos de avaliação não públicos e problemas de domínio específico para medir generalização.

- Medir latência P95/P99 e custos operacionais reais num pipeline de produção, além da acurácia sintética.

- Comparar resultados com benchmarks independentes publicados em repositórios públicos e literatura técnica.

Para leitores interessados nas interseções entre segurança e agentes de IA, vale consultar também a cobertura sobre mecanismos autônomos de defesa em nuvem, que contextualiza riscos operacionais e de robustez, como no artigo “Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem” — https://timension.com.br/agentes-ia-seguranca-automatizacao-ataques/.

Prévias DeepSeek V4: nota sobre transparência e expectativa de auditoria

As Prévias DeepSeek V4 cumprem papel informativo importante, mas não dispensam auditoria externa. A transparência em detalhes de dataset, seeds de aleatoriedade, versões de avaliação e logs de inferência é crítica para que a comunidade técnica possa validar as reivindicações. Modelos MoE e estratégias de quantização introduzem variáveis adicionais que impactam replicabilidade; portanto, próximos relatórios e trabalhos independentes deverão focar em protocolos de teste padronizados para medir de modo confiável vantagem competitiva versus custos.

Imagem sugerida (alt): “Prévias DeepSeek V4 — gráfico comparativo de benchmarks de raciocínio e programação mostrando V4‑Pro‑Max com 80,6% no SWE‑bench”.

Prévias DeepSeek V4: preços por token e posicionamento no mercado

Prévias DeepSeek V4 — preços por token e impacto no mercado

Prévias DeepSeek V4 chegam ao centro das discussões do mercado com números explícitos: o plano Flash a US$ 0,14 por milhão de tokens de entrada e o plano Pro a US$ 1,74 por milhão na entrada e US$ 3,48 por milhão na saída. Estas Prévias DeepSeek V4 sinalizam uma estratégia de preço que busca reposicionar modelos gigantes com arquitetura MoE (Mixture of Experts) em segmentos sensíveis a custos, oferecendo combinações de latência, capacidade e economia para aplicações em escala. A apresentação dos valores nas Prévias DeepSeek V4 traz à tona perguntas sobre como times de infraestrutura e arquitetos de software irão reavaliar pipelines de inferência, batchamento e retenção de contexto para reduzir gastos operacionais.

As Prévias DeepSeek V4 não apenas documentam preços; elas definem um ponto de comparação comercial que já força benchmarks internos. Para empresas que hoje balanceiam custo e performance entre instâncias on-premise, clusters gerenciados e calls para APIs públicas, as Prévias DeepSeek V4 oferecem um novo vetor de decisão: migrar cargas de trabalho para endpoints otimizados por MoE com custo de entrada significativamente reduzido, aproveitando modelos especializados em escala sem o ônus tradicional de preços por token elevados. Além do preço nominal, é preciso avaliar throughput, latência de saída e custos associados a tokens de resposta — exatamente o que as Prévias DeepSeek V4 deixam claros ao separar valores de entrada e saída no plano Pro.

No plano Flash das Prévias DeepSeek V4, o custo de US$ 0,14 por milhão de tokens de entrada aponta para cenários de uso intensivo de prompts de leitura ou classificação, onde a maioria dos tokens processados são inputs. Em contraste, o plano Pro, com US$ 1,74/milhão na entrada e US$ 3,48/milhão na saída, evidencia um posicionamento para workloads que exigem maior capacidade de geração de texto e retornos volumosos. A arquitetura MoE das Prévias DeepSeek V4 permite ajustar especialização de experts para reduzir custo por token efetivo em tarefas bem definidas, e esse trade-off entre Flash e Pro será material para equipes que trabalham com análise de logs, indexação semântica e assistentes conversacionais empresariais.

Ao comparar as Prévias DeepSeek V4 com fornecedores alternativos, observadores devem cruzar fatores: preço por token, diferenciação entre entrada e saída, modelos de latência, e políticas de escalonamento. Recursos públicos de concorrentes oferecem contextos para análise, como as páginas de preços da OpenAI (https://openai.com/pricing), a cartilha de preços da Anthropic (https://www.anthropic.com/pricing) e as tarifas de inferência do Google Vertex AI (https://cloud.google.com/vertex-ai/pricing). Com esses pontos de referência, a leitura das Prévias DeepSeek V4 permite identificar quando compensa migrar cargas para endpoints MoE sob custo menor por token de entrada ou manter modelos concorrentes para cenários que exigem respostas gigantes em saída.

Um efeito prático das Prévias DeepSeek V4 é a possível reorganização de arquitetura: empresas podem optar por empilhar pipelines híbridos, mantendo inferência crítica em modelos proprietários ou mais caros apenas para etapas que exigem maior fidelidade, enquanto delegam tarefas de pré-processamento, classificação, embedding e triagem para instâncias Flash mais econômicas. Essa segmentação, baseada nos preços divulgados nas Prévias DeepSeek V4, reduz custos diretos e altera prioridades de engenharia, como políticas de cache de resposta, compressão de contexto e estratégias de truncamento inteligente.

- Impacto em design de custo: As Prévias DeepSeek V4 tornam mais viável a estratégia “filter-then-generate”, onde filtros e classificadores rodam no Flash a US$ 0,14/milhão e a geração final apenas em modelos Pro quando necessária, reduzindo tokens de saída acumulados.

- Rebalanceamento de infraestrutura: Times de SRE podem reavaliar custos de escalonamento automático, optando por mais chamadas paralelas de baixo custo via Flash para picos de ingestão e escalando Pro em picos controlados de geração.

- Alteração em métricas de sucesso: Métricas financeiras por funcionalidade (custo por resposta útil) ganham relevância frente às métricas puramente técnicas, dado que as Prévias DeepSeek V4 mudam a equação de custo-benefício.

Para desenvolvedores, as Prévias DeepSeek V4 incentivam otimizações no nível do prompt e do token usage. Práticas como compactar histórico de conversas, preferir embeddings para buscas semânticas e reduzir tokens de saída por meio de instruções mais objetivas tornam-se ainda mais valiosas quando a camada de entrada é barata, mas a saída tem custo separado no plano Pro. Além disso, equipes de produto podem explorar modelos MoE das Prévias DeepSeek V4 para treinar experts internos que representam domínios específicos, obtendo ganhos de custo por token em cenários repetitivos e dominios com vocabulário especializado.

Em termos de posicionamento no mercado, as Prévias DeepSeek V4 atuam como catalisador para competição de preços e diferenciação por arquitetura. Enquanto players estabelecidos competem em performance genérica e tempo de resposta, a proposta das Prévias DeepSeek V4 — combinar MoE com escalonamento de preços por tipo de token — pressiona rivais a oferecer planos com granularidade similar. O movimento pode levar a maior transparência nas tabelas de preço, segmentação por tipo de uso (ingestão intensa versus geração volumosa) e acordos contratuais que incentivem previsibilidade de gasto para clientes corporativos.

Outra consequência prática das Prévias DeepSeek V4 é a reavaliação de custos de manutenção de infra on-premise. Empresas que mantêm clusters por controle e segurança podem recalcular o custo total de propriedade frente ao mercado: se o preço de inferência pública, exemplificado nas Prévias DeepSeek V4, for competitivo em workloads comuns, o retorno sobre o investimento em hardware próprio diminui, especialmente para tarefas de baixa latência de leitura e indexação. Clientes com requisitos regulatórios ou de soberania ainda manterão opções locais, mas as Prévias DeepSeek V4 reconfiguram o limiar de migração para cloud.

Do ponto de vista de integração e operação, as Prévias DeepSeek V4 também incentivam mudanças em políticas de observabilidade. Logs de tokens, alertas de consumo e relatórios de custo por funcionalidade se tornam obrigatórios para controlar gastos com planos que cobram diferentemente entrada e saída. Ferramentas internas que correlacionam gasto por endpoint com métricas de negócio serão essenciais para aproveitar os benefícios de preço divulgados nas Prévias DeepSeek V4 sem surpresas orçamentárias.

No âmbito competitivo, é relevante acompanhar documentos e casos de uso que exemplifiquem ganhos reais com a estrutura de preços das Prévias DeepSeek V4. Estudos de caso que comparem total cost of ownership entre arquiteturas com maior uso de tokens de entrada versus saída clarificam quando migrar ou manter provedores alternativos. Pesquisas abertas e benchmarks independentes poderão se valer das tabelas de preço das Prévias DeepSeek V4 para criar cenários replicáveis de custo por milhão de tokens.

Há também impactos no ecossistema de desenvolvedores e startups: modelos de precificação como os das Prévias DeepSeek V4 reduzem barreiras de entrada para experimentação em grande escala, permitindo que equipes lancem versões de teste com volume de consultas elevado sem comprometer orçamento. Plataformas de integração, provedores de middleware e ferramentas de observabilidade devem ajustar planos comerciais e camadas gratuitas para acomodar esse novo patamar de acesso econômico a modelos MoE.

Para quem acompanha movimentações de segurança e automação, é recomendável correlacionar a leitura das Prévias DeepSeek V4 com desenvolvimentos paralelos do setor; por exemplo, veja a cobertura sobre agentes de IA aplicados à defesa e automação de resposta em nuvem, como na notícia Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem (https://timension.com.br/agentes-ia-seguranca-automatizacao-ataques/), que trata de decisões arquiteturais próximas às discussões de custo e eficácia levantadas pelas Prévias DeepSeek V4.

Por fim, detalhes operacionais como contratos de SLA, limites de taxa e políticas de uso são variáveis que definirão o valor real das Prévias DeepSeek V4 para clientes corporativos. Enquanto os números públicos (US$ 0,14/milhão no Flash; US$ 1,74/milhão entrada e US$ 3,48/milhão saída no Pro) orientam decisões iniciais, a adoção em larga escala dependerá de testes de integração, validação de latência e claras métricas de economia operacional para workloads típicos de cada organização.

Alt text sugerido para imagens associadas a este conteúdo: “Prévias DeepSeek V4 — comparação de preços por token e impacto de arquitetura MoE”.

Prévias DeepSeek V4: requisitos de infraestrutura e execução local

Prévias DeepSeek V4 — requisitos de infraestrutura e execução local

Prévias DeepSeek V4 chegam ao mercado com especificações que forçam uma reavaliação imediata da viabilidade de execução local: o mais enxuto dos lançamentos, o V4-Flash, ocupa cerca de 160 GB em disco model-ready e pode ser executado em máquinas com 128 GB de RAM, enquanto a versão Pro pesa aproximadamente 865 GB, exigindo configurações de memória e armazenamento muito acima da média de servidores convencionais. Essas diferenças de tamanho entre as variantes das Prévias DeepSeek V4 moldam decisões sobre quantização, offloading e estratégias de sharding, impactando diretamente equipes de pesquisa menores e empresas com orçamentos limitados.

A arquitetura MoE (Mixture of Experts) presente nas Prévias DeepSeek V4 contribui para a eficiência por parâmetro, mas também introduz requisitos de comunicação entre shards que complicam a execução local. Em ambientes que não dispõem de interconexões de alta largura de banda e baixa latência (por exemplo, NVLink ou interconexões RDMA entre nós), os ganhos de MoE podem ser mitigados por overheads de sincronização. Para pesquisadores que consideram rodar o V4-Flash em estações com 128 GB de RAM, isso significa que a execução inteira em uma única máquina é plausível para inferência com quantização agressiva, enquanto a versão Pro demanda clusterização e soluções de offload para armazenamento em NVMe ou memória do host.

Do ponto de vista operacional, a adoção das Prévias DeepSeek V4 localmente requer atenção a três camadas: hardware, software e práticas de quantização. No hardware, recomenda-se SSD NVMe de alta performance para alojar os pesos quando o modelo não couber totalmente na GPU; memória RAM de sistema generosa para hosting de cache e pipelines de pré-processamento; e GPUs com capacidade suficiente de VRAM para carregar shards críticos. No software, bibliotecas de offloading como DeepSpeed, bibliotecas de quantização como bitsandbytes, e runtimes otimizados para MoE são fundamentais. Em relação à quantização, as Prévias DeepSeek V4 se beneficiam de esquemas 8-bit ou 4-bit bem calibrados para manter qualidade, diminuindo exigências de memória em até 4x em comparação aos pesos em float32.

- Requisitos mínimos práticos: Para V4-Flash com quantização 8-bit, um servidor com 128 GB de RAM, 2–4 GPUs de 24–48 GB (ou uma GPU grande e suporte de offload) e NVMe rápido. Para a Pro, é realista prever necessidade de 512+ GB de RAM, múltiplas GPUs interconectadas e políticas de sharding.

- Armazenamento: V4-Flash: ~160 GB; V4-Pro: ~865 GB. Reservar espaço adicional para checkpoints, cache e pipelines de dados é obrigatório.

- Software: suporte a DeepSpeed/Megatron-LM para sharding; bibliotecas de quantização como bitsandbytes; ferramentas para profiling de comunicação.

- Rede: interconexões de alta largura de banda são recomendadas para clusters que visem rodar a versão Pro com latência aceitável.

A quantização se mostra o fator decisivo na acessibilidade das Prévias DeepSeek V4. Com quantização 8-bit bem aplicada, o V4-Flash transita de um requisito de 160 GB para algo na faixa de 40–60 GB de espaço efetivo de parâmetros em memória, tornando a execução em máquinas com 128 GB de RAM e swap/NVMe de apoio viável para inferência. Já para a Pro, mesmo com quantização 4-bit e técnicas avançadas de compressão, o esforço para reduzir 865 GB a algo que caiba confortavelmente em um servidor único costuma ser impraticável, forçando a adoção de execução distribuída ou o uso de serviços na nuvem. A quantização, porém, não é neutra: depende de calibração, calor de ativação e técnicas de pós-treinamento; erros de quantização podem degradar a precisão em tarefas sensíveis, o que exige validação rigorosa.

Do ponto de vista econômico, as Prévias DeepSeek V4 apresentam uma proposta paradoxal: preços por licença e acesso mais baixos que rivais posicionam o conjunto como uma opção atraente, mas os custos de infraestrutura para rodar a variante Pro podem anular ganhos de preço para muitas organizações. Para empresas menores e grupos acadêmicos, o V4-Flash quantizado representa a opção prática: menor custo inicial, possibilidade de execução on-premises e um caminho claro para experimentação. Instituições com acesso a clusters HPC ou acordos de nuvem com instâncias rajadas (GPUs de alta memória) poderão explorar a Pro com mais fidelidade, mas precisarão planejar redes, orquestração e armazenamento.

Além do custo direto de hardware, há outros vetores que afetam a viabilidade local das Prévias DeepSeek V4: consumo energético, resfriamento e complexidade operacional. Rodar múltiplas GPUs interconectadas por longos períodos aumenta a conta de energia e pode demandar infraestruturas de data center, o que reduz a atratividade do “self-hosting” para laboratórios e startups que operam em espaços limitados. Para mitigar isso, muitas equipes optam por uma estratégia híbrida: prototipagem local com V4-Flash quantizado e transferência para nuvem ou clusters para fases de produção com modelos maiores.

Do ponto de vista da pesquisa, as Prévias DeepSeek V4 abrem espaço para experimentos sobre eficiência de MoE e granularidade de experts. A arquitetura MoE permite ativar apenas subconjuntos do modelo por entrada, teoricamente reduzindo custo computacional por inferência; na prática, a eficácia depende de compatibilidade de runtime e da capacidade de orquestrar experts distribuídos. Pesquisadores sem acesso a grandes infraestruturas podem reproduzir avaliações com o V4-Flash e simulações de MoE reduzidas, mas a observabilidade completa do comportamento em escala exige recursos complementares.

Interoperabilidade com ferramentas de otimização é outro aspecto chave quando se avalia executar as Prévias DeepSeek V4 localmente. Ferramentas de quantização como bitsandbytes, rotinas de export para formatos otimizado em disco (por exemplo ONNX com quantização) e soluções de offload como ZeRO/DeepSpeed são peças centrais do ecossistema. A adoção de pipelines padronizados facilita replicabilidade entre laboratórios e acelera a integração com soluções de segurança e monitoramento, tema que conecta-se a áreas como defesa em nuvem — para exemplos de integração entre agentes automatizados e práticas de segurança veja a matéria sobre Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem, que ilustra preocupações operacionais e de supervisão em ambientes de IA em larga escala.

Em termos de governança e compliance, a execução local das Prévias DeepSeek V4 oferece vantagens e desvantagens: hospedar dados sensíveis on-premises reduz exposição a terceiros, mas impõe responsabilidades sobre proteção de dados, auditoria de modelos e atualização de patches. Para organizações reguladas, a capacidade de manter controle total sobre o ciclo de vida do modelo pode justificar o investimento em infraestrutura para rodar variantes maiores, ainda que a alternativa de usar o V4-Flash localmente e delegar cargas maiores para provedores externos se mostre mais prática.

Considerando a trajetória de adoção, um roteiro pragmático para equipes que desejam experimentar as Prévias DeepSeek V4 localmente seria: 1) iniciar com V4-Flash quantizado para validar casos de uso; 2) estabelecer pipelines de quantização e validação de qualidade; 3) orquestrar testes de offload com NVMe para avaliar latência e throughput; 4) escalar para execução distribuída apenas quando os benefícios de usar a Pro superarem custos de infraestrutura e complexidade operacional. Esse caminho equilibra experimentação e risco financeiro, e pode acelerar a maturação de aplicações sem comprometer a qualidade científica.

Para desenvolvedores e administradores de sistemas, recomendações práticas incluem manter um ambiente de testes com profiling de memória, investir em monitoramento da comunicação entre GPUs e automatizar rotinas de fallback para offload quando a memória de GPU se esgotar. Ferramentas open source e bibliotecas de quantização devem ser testadas contra conjuntos de validação específicos para detectar regressões introduzidas por compressão. Em ambientes cooperativos, a documentação detalhada do setup de execução das Prévias DeepSeek V4 é essencial para replicabilidade e para evitar surpresas operacionais durante o escalonamento.

Uma observação final sobre acessibilidade: enquanto preços menores para as licenças das Prévias DeepSeek V4 reduzem uma barreira de entrada, a necessidade de hardware, conhecimento de quantização e orquestração cria um novo conjunto de requisitos que pode excluir atores menores, a menos que conjuntem soluções comunitárias, acordos de acesso a HPC ou parcerias com provedores de nuvem. Modelos híbridos e iniciativas de compartilhamento de recursos podem ser caminhos viáveis para democratizar o acesso sem comprometer experimentação científica, destacando que a disponibilidade do modelo é apenas um lado da equação.

Observando o panorama técnico e operacional, as Prévias DeepSeek V4 representam um avanço significativo em eficiência por parâmetro via MoE, mas a execução local plena, especialmente da variante Pro, permanece condicionada a investimentos em memória, armazenamento rápido e infraestrutura de rede que muitas organizações ainda precisam planejar cuidadosamente.

Prévias DeepSeek V4: integração, licenciamento e uso comercial

Prévias DeepSeek V4 chegam ao radar das equipes técnicas e de negócios com promessas de desempenho e custo — a expressão “Prévias DeepSeek V4” orienta a análise a seguir, que explora a licença MIT para uso comercial, caminhos imediatos de integração e cenários práticos onde a adoção dos modelos V4 traz vantagem econômica e técnica. A leitura foca nos impactos legais e operacionais, sem jargões promocionais, e apresenta recomendações factíveis para quem precisa decidir entre treinar do zero, adaptar modelos existentes ou integrar via APIs.

Prévias DeepSeek V4: implicações práticas da licença MIT para uso comercial

Ao avaliar “Prévias DeepSeek V4”, a primeira questão é a licença MIT: ela concede permissões amplas para uso, modificação e distribuição, inclusive em aplicações comerciais, desde que a atribuição seja preservada. Isso significa que empresas que desejam incorporar as “Prévias DeepSeek V4” em produtos pagos podem fazê-lo sem pagar royalties diretos, mas precisam manter avisos de copyright e licença nas distribuições de código-fonte que incluam trabalho derivado. Na prática, isso reduz barreiras contratuais e acelera PoCs (provas de conceito) e prototipagem interna, pois elimina processos longos de negociação de licenças proprietárias.

Entretanto, para projetos que combinam as “Prévias DeepSeek V4” com terceiros, é necessário revisar dependências e bibliotecas adicionais — bibliotecas com licenças copyleft, por exemplo, podem impor restrições que não são cobertas pela MIT. Em termos de compliance, equipes jurídicas das empresas devem documentar como os arquivos contendo as “Prévias DeepSeek V4” foram integrados, incluindo notas de atribuição, para manter conformidade em auditorias e ao preparar pacotes binários que serão distribuídos para clientes ou parceiros. Para esclarecer o escopo da MIT, consulte a página oficial da licença MIT no Open Source Initiative: https://opensource.org/licenses/MIT.

Prévias DeepSeek V4: rotas de integração imediatas

- API hospedada — integrar as “Prévias DeepSeek V4” por meio de endpoints gerenciados reduz tempo de implantação e terceiriza atualizações de infraestrutura, mantendo escalabilidade; é a rota mais rápida para equipes sem expertise profunda em provisionamento de GPU/TPU.

- Containerização e implantação on-premises — para dados sensíveis, implantar containers com imagens que incorporam as “Prévias DeepSeek V4” permite controle total sobre logs, telemetria e compliance; exige investimento em orquestração e pipelines de CI/CD.

- Edge e inferência embarcada — versões otimizadas das “Prévias DeepSeek V4” podem ser quantizadas para execução em aceleradores menores, oferecendo latência reduzida para casos de uso em campo.

- Integração via frameworks ML — pacotes prontos para PyTorch, TensorFlow ou JAX agilizam adaptação e fine-tuning das “Prévias DeepSeek V4”, especialmente quando combinados com bibliotecas de pipelines de inferência.

- Arquitetura híbrida MoE — a própria natureza MoE (Mixture of Experts) das “Prévias DeepSeek V4” permite estratégias híbridas: usar especialistas localmente para cargas críticas e delegar experts menos sensíveis a serviços gerenciados.

Para equipes que querem começar imediatamente, um roteiro prático inclui: 1) validar requisitos de compliance da MIT; 2) escolher a rota de integração alinhada à sensibilidade dos dados; 3) executar um PoC de 4 a 6 semanas com métricas de custo e latência; 4) avaliar opções de escalonamento e observabilidade. Uma referência técnica útil sobre arquiteturas MoE é o artigo do Switch Transformer: https://arxiv.org/abs/2007.08966, que ajuda a entender trade-offs de eficiência nas “Prévias DeepSeek V4”.

Prévias DeepSeek V4: cenários de uso com vantagem econômica e técnica

- Pesquisa e descoberta de conteúdo para plataformas de mídia: as “Prévias DeepSeek V4” podem reduzir custos por consulta quando comparadas a modelos densos de similar capacidade, graças à estrutura MoE que ativa apenas subconjuntos de parâmetros durante a inferência; isso melhora custo-benefício em serviços de recomendação de alta taxa de leitura.

- Automação de atendimento ao cliente em larga escala: com a licença MIT, equipes podem personalizar os modelos para fluxo de diálogo e integrar internamente sem custos de licença, tornando as “Prévias DeepSeek V4” competitivas para empresas que atendem milhões de consultas mensais.

- Indexação semântica e busca empresarial: ao adotar as “Prévias DeepSeek V4” para vetorização e recuperação, empresas com grandes repositórios documentais podem reduzir latência e custo total de propriedade ao empregar rotas on-premise combinadas com caching e inferência por batch.

- Segmentação de clientes e análise preditiva: equipes de data science podem fine-tunear as “Prévias DeepSeek V4” para tarefas verticais sem barreiras comerciais, acelerando experimentos A/B e diminuindo tempo de iteração entre hipótese e produção.

- Produtos embarcados e aplicações de baixa latência: versões quantizadas das “Prévias DeepSeek V4” são viáveis para dispositivos que exigem modelos compactos com alto throughput, resultando em economia de custos de infraestrutura e melhoria de experiência do usuário.

Em cenários industriais, a economia direta advém principalmente da combinação entre menor custo de licenciamento e eficiência operacional proporcionada pela MoE: ao ativar apenas “experts” relevantes, as “Prévias DeepSeek V4” reduzem consumo computacional em consultas de produção, o que se traduz em faturas de cloud mais baixas. Além disso, para empresas que precisam manter IP e modelos proprietários sem dependências proprietárias, a licença MIT remove barreiras legais comuns a licenças comerciais.

Prévias DeepSeek V4: considerações técnicas para adoção

Técnicamente, a adoção das “Prévias DeepSeek V4” demanda atenção a três pontos principais: dimensionamento de infraestrutura (GPU/TPU), pipelines de dados e observabilidade de inferência. A arquitetura MoE pode introduzir variabilidade na latência de respostas dependendo do roteamento de experts, então é recomendável instrumentar métricas de latência por caminho e implementar técnicas de balanceamento e cache. Também é crítico preparar pipelines de dados que preservem qualidade e representatividade para evitar viéses em fine-tuning.

Para equipes que planejam rodar inferência em larga escala, modelos MoE como as “Prévias DeepSeek V4” usualmente beneficiam-se de estratégias de sharding e paralelismo de experts; provedores de infraestrutura oferecem soluções que otimizam o roteamento e a alocação de memória, reduzindo a sobrecarga operacional. Ferramentas de observabilidade e APM que suportem tracing distribuído ajudam a diagnosticar degradações de performance relacionadas ao roteamento entre experts.

Prévias DeepSeek V4: riscos regulatórios e mitigação

Mesmo com licença permissiva, o uso comercial das “Prévias DeepSeek V4” envolve riscos regulatórios típicos de modelos de linguagem: exposição de dados sensíveis em treino, geração de conteúdo que infringe direitos de terceiros e responsabilidade por outputs indevidos. Mitigações práticas incluem usar dados anonimizados para fine-tuning, aplicar filtros de segurança em tempo de inferência e manter logs de decisão quando modelos automatizam fluxos críticos. Para empresas que integram IA com foco em defesa e segurança, vale revisar estudos correlatos, como este sobre agentes de IA para segurança, disponível em nosso blog: Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem, que descreve como automação influencia postura defensiva em ambientes de nuvem.

Prévias DeepSeek V4: checklist operacional para adoção

- Validação legal da MIT e revisão de dependências;

- Prova de conceito com métricas claras de custo por inferência e latência;

- Planejamento de infraestrutura para MoE (sharding, roteamento de experts);

- Estratégia de segurança e privacidade para dados de treino e inferência;

- Instrumentação de observabilidade e testes de regressão de desempenho;

- Políticas de versão e governança de modelos para atualizações e rollback.

Para times de produto, a recomendação prática é separar pilotos que visem redução de custo operacional (substituir consultas a modelos densos caros) daqueles que buscam inovação funcional (novas capacidades habilitadas por modelos maiores). Em ambos os casos, as “Prévias DeepSeek V4” podem oferecer vantagem competitiva se integradas com governança e monitoramento adequados.

Prévias DeepSeek V4: nota sobre interoperabilidade e ecossistema

A compatibilidade das “Prévias DeepSeek V4” com frameworks populares e a disponibilidade sob MIT facilitam a construção de stacks híbridos: ferramentas de orquestração, bibliotecas de vetorização semântica e plataformas MLOps podem ser combinadas sem amarras legais. Projetos que já usam arquiteturas MoE encontrarão sinergia técnica imediata ao avaliar as “Prévias DeepSeek V4” como opção de backbone para serviços de recuperação de informação e classificação por afinidade.

Além das implicações práticas e técnicas, é relevante acompanhar atualizações de governança e guias de compliance que emergem à medida que empresas implementam essas soluções em escala; manter uma linha direta entre equipes legais, de segurança e de arquitetura acelera decisões e evita surpresas operacionais. A última nota operacional é que a licença MIT facilita experimentação aberta e colaboração entre equipes, promovendo ciclos de inovação mais rápidos com as “Prévias DeepSeek V4”.

As informações acima oferecem um panorama prático para decisões imediatas sobre adoção das “Prévias DeepSeek V4”, combinando análise de licença, opções de integração e cenários de economia; a aplicação adequada dependerá do contexto regulatório e das prioridades técnicas de cada organização.

Prévias DeepSeek V4: riscos, governança e próximos passos da DeepSeek

Prévias DeepSeek V4

Prévias DeepSeek V4 aparecem como um marco técnico e comercial que merece acompanhamento atento: a sigla e o nome “Prévias DeepSeek V4” já mostram que a empresa aposta em modelos de grande escala com arquitetura Mixture of Experts (MoE) e preços agressivos para competir com incumbentes fechados. Nas Prévias DeepSeek V4, observadores apontam tanto avanços de custo-eficiência quanto riscos operacionais e de governança que podem impactar adoção, conformidade e reputação da DeepSeek.

As Prévias DeepSeek V4 trazem indicadores de desempenho promissores em benchmarks internos, mas especialistas advertiram que esses resultados exigem validação externa. A diferença entre métricas de laboratório e comportamento em produção suscita dúvidas clássicas sobre generalização e robustez: a DeepSeek precisa demonstrar que as Prévias DeepSeek V4 mantêm segurança sob cargas diversas, respostas adversas e entradas fora da distribuição.

- Gaps em benchmarks e comparação com líderes fechados: As Prévias DeepSeek V4 mostram ganhos em custo por token e throughput graças ao MoE, porém faltam comparações padronizadas e auditáveis frente a modelos fechados líderes. Relatórios comparativos independentes e conjuntos de avaliação públicos são necessários para validar alegações de eficiência e qualidade.

- Necessidade de auditoria de segurança: As Prévias DeepSeek V4 demandam auditorias de segurança por terceiros para mapear vetores de ataque, vazamento de dados e possíveis superfícies exploráveis por usuários maliciosos ou por cadeias de supply. Auditorias externas fortalecem confiança e ajudam a identificar regressões entre versões privadas e públicas.

- Viés e comportamento indesejado em modelos abertos: Como outros modelos abertos, as Prévias DeepSeek V4 enfrentam o desafio de vieses e respostas imprevisíveis. A transparência de dados de treinamento, se possível, e métricas de equidade são instrumentos necessários para mitigar enviesamentos e para permitir que a comunidade reprodutível verifique resultados.

No campo da governança, as Prévias DeepSeek V4 expõem necessidades concretas: políticas de controle de acesso, mecanismos de rate limiting, processos de resposta a incidentes e termos de uso alinhados a normas de segurança internacional. A adoção de frameworks como a AI Incident Database e práticas de disclosure responsáveis pode ajudar a DeepSeek a documentar falhas e lições aprendidas de forma transparente. Fontes de referência aplicáveis incluem o registro público de incidentes (https://incidentdatabase.ai/) e publicações sobre escalabilidade MoE, que contextualizam as escolhas arquiteturais.

Um ponto crítico nas Prévias DeepSeek V4 é a gestão de custos versus desempenho: enquanto o uso de MoE reduz custos em workloads de inferência, ele também introduz complexidade em orquestração e checkpointing, algo que pode gerar regressões de latência em cenários de baixa ocupação ou em distribuições heterogêneas de hardware. Observadores do mercado devem monitorar métricas de latência tail e custo total de propriedade além de números médios de throughput.

Quanto ao engajamento da comunidade de pesquisa, as Prévias DeepSeek V4 precisam demonstrar abertura efetiva: release de modelos compactos para reprodução, benchmarks padronizados e submissão de papers ou whitepapers que detalhem arquitetura MoE, técnicas de sparsificação e estratégias de mitigação de vieses. O volume e a qualidade das contribuições externas, assim como a resposta da DeepSeek a relatórios independentes, serão sinais claros de maturidade.

- Sinais de progresso que o mercado deve acompanhar:

- Lançamento de conjuntos de avaliação públicos para as Prévias DeepSeek V4 e pontuações em benchmarks independentes.

- Publicação de whitepapers técnicos que detalhem treino, curadoria de dados e mitigação de vieses.

- Adoção de auditorias de segurança por terceiros e comunicados públicos sobre correções e hardening.

- Relatórios de latência tail, custo total de operação e métricas de eficiência energética em cenários reais.

- Atividade da comunidade de pesquisa: forks, reimplementações e críticas construtivas que validem ou contestem as alegações das Prévias DeepSeek V4.

Há ainda preocupações regulatórias que as Prévias DeepSeek V4 devem antecipar: requisitos de explicabilidade, proteção de dados pessoais em conformidade com leis locais e requisitos de auditorabilidade em setores sensíveis. Um aparelho de governança interna deve incluir um comitê de risco para priorizar mitigação técnica e legal em atualizações sucessivas.

Em termos práticos, a integração com parceiros e clientes será um indicador valioso. A velocidade com que clientes de setores regulados adotam as Prévias DeepSeek V4, e as condições contratuais associadas, revelarão o nível de confiança institucional no produto. Além disso, colaborações com grupos acadêmicos e centros de pesquisa tendem a acelerar a detecção de vieses e falhas, criando feedback que pode ser medido por pull requests, issues abertas e preprints que citam as Prévias DeepSeek V4.

Um aspecto operacional crítico nas Prévias DeepSeek V4 é a cadeia de suprimentos de modelos: dependências de bibliotecas, fornecedores de hardware e provedores de nuvem influenciam a resiliência e a capacidade de replicação. Relatórios de auditoria e inventário de componentes ajudam a mapear riscos de dependência e pontos únicos de falha. Para exemplos de automação de defesa e antecipação de ataques em ambientes de nuvem, ver casos práticos como o uso de agentes de IA na defesa automatizada detalhados no artigo sobre Agentes de IA para segurança: Google automatiza defesa e antecipa ataques na nuvem, que traz contexto sobre integração entre modelos e infraestruturas seguras.

Do ponto de vista de alinhamento de valores, as Prévias DeepSeek V4 devem especificar claramente políticas de uso aceitável e estabelecer workflows para relatar conteúdos indevidos. Ferramentas de content filtering, adversarial training e pipelines de revisão humana tendem a ser necessárias para reduzir casos de geração prejudicial. A adoção de métricas padronizadas para medir toxicidade e viés ajudará a comparar versões e a demonstrar progresso público.

- Recomendações de monitoramento e próximos passos a observar:

- Publicação de benchmarks independentes e reprodutibilidade das Prévias DeepSeek V4.

- Relatórios de auditoria de segurança e de privacidade por organizações reconhecidas.

- Transparência sobre datasets de treino e processos de curadoria que alimentam as Prévias DeepSeek V4.

- Métricas operacionais em produção: latência tail, custo por requisição e comportamento sob ataque adversarial.

- Volume e qualidade do envolvimento da comunidade de pesquisa e feedback público.

Por fim, as Prévias DeepSeek V4 oferecem uma janela para entender trade-offs entre abertura e controle: modelos abertos favorecem auditoria e colaboração, mas expõem vetores de uso indevido que exigem governança ativa. A evolução das Prévias DeepSeek V4 dependerá tanto de avanços técnicos quanto da capacidade institucional da DeepSeek de instituir práticas de segurança, governança e transparência compatíveis com as expectativas do mercado e das autoridades, além da robustez demonstrada em versões subsequentes.

Perguntas Frequentes

O que são o DeepSeek‑V4‑Pro e o DeepSeek‑V4‑Flash?

São duas prévias de modelos da DeepSeek com arquitetura Mixture of Experts (MoE). O DeepSeek‑V4‑Pro reúne 1,6 trilhão de parâmetros totais e foca em escala máxima e cobertura ampla de tarefas; o DeepSeek‑V4‑Flash tem 284 bilhões de parâmetros e visa menor latência e custo operacional, sendo mais indicado para implantações com restrições de resposta e recursos.

Como a arquitetura MoE reduz os custos por token nesses modelos?

Em MoE cada camada contém múltiplos “especialistas” e um roteador seleciona apenas um subconjunto deles para cada token/entrada. Assim, embora o inventário total de parâmetros seja enorme, somente uma fração é ativada por inferência, reduzindo o custo computacional por token e permitindo capacidade representacional elevada sem custo de execução equivalente a um modelo denso do mesmo tamanho.

Qual a diferença entre “parâmetros totais” e “parâmetros ativados por inferência”?

“Parâmetros totais” é o inventário completo do modelo (todos os pesos treinados). “Parâmetros ativados por inferência” são apenas os pesos usados para processar uma entrada específica — no MoE isso equivale ao conjunto de especialistas selecionados pelo roteador. Portanto um modelo com 1,6 trilhão de parâmetros pode ativar apenas dezenas a algumas centenas de bilhões em uma chamada, dependendo da configuração do roteador e do número de especialistas acionados por token.

É possível executar os DeepSeek V4 localmente e qual é a janela de contexto disponível?

As prévias anunciam suporte a execução local estendendo janelas de contexto de até 1 milhão de tokens, o que facilita tarefas que exigem contexto extenso. Na prática, a viabilidade de execução local depende do perfil (Pro vs Flash), da configuração de especialistas ativados e do hardware disponível — o Flash tende a ser mais simples de implantar por ter menos parâmetros efetivamente usados por inferência.

Quais são os principais trade‑offs e limitações ao usar modelos MoE como os DeepSeek V4?

Os trade‑offs incluem sensibilidade ao mecanismo de roteamento (latência e throughput variam conforme o roteador), risco de ‘hot spots’ quando poucos especialistas são acionados com frequência excessiva, e necessidade de suporte de hardware/software para computação esparsa eficiente. Ajustes finos no balanceamento de especialistas e infraestrutura adequada são necessários; modelos menores como o Flash reduzem parte desses desafios em troca de menor capacidade máxima.

Gostou deste conteúdo? Receba o Material Completo!

Cadastre-se gratuitamente em nossa lista VIP para destravar ferramentas, PDFs e análises profundas que complementam esta leitura diretamente no seu e-mail.

Nota de contexto

O cenário descrito depende de indicadores e decisões regulatórias em evolução; alterações nessas variáveis podem impactar custos, prazos e responsabilidades. Consulte as fontes originais mencionadas no texto e, quando aplicável, solicite avaliação técnica local para ajustar medidas e decisões conforme as condições vigentes.